AIを活用したシステム開発支援を行う株式会社Walkersです。

これまで多くの企業さまからAI開発に関するご相談をいただく中で、特によく聞かれるのが次のような疑問です。

- バイブコーディングってセキュリティは大丈夫なの?

- AIを使った開発は危険ではないの?

最近は生成AIに関する情報漏洩やセキュリティ事故のニュースも増えており、不安に感じる方も多いのではないでしょうか。

しかし、結論から言うと、バイブコーディングそのものが危険というわけではありません。

むしろ、適切な設計と運用ルールを整えることで、従来の開発よりも安全性を高められるケースもあります。

この記事では、バイブコーディングのセキュリティについて、次の内容を中心に分かりやすく解説していきます。

バイブコーディングにおけるセキュリティリスクや注意点を正しく理解し、不安を解消したうえで安心してAI開発を進められるようになりますので、ぜひ最後までご覧ください。

執筆者:山口 鳳汰

累計100万PV以上のAI・ノーコード専門メディアの編集長。

アプリ開発の電子書籍を3冊出版し、1冊はAmazonベストセラーを獲得。

その他、受託開発や教育など多数のノーコード事業に参画している。

運営会社:株式会社Walkers

AI・ノーコード専門の開発会社。

300件以上の開発/制作実績、200件以上の企業様を支援。

マーケティングやUI/UXと掛け合わせたサービス開発を得意としている。

執筆者:山口 鳳汰

累計100万PV以上のAI・ノーコード専門メディアの編集長。

アプリ開発の電子書籍を3冊出版し、1冊はAmazonベストセラーを獲得。

運営会社:株式会社Walkers

AI・ノーコード専門の開発会社。

これまでに300件以上の開発/制作実績、200件以上の企業様を支援。

【結論】バイブコーディング(AI駆動開発)のセキュリティは弱くない

初めにもお伝えしましたが、バイブコーディングのセキュリティが特別弱いという事実はありません。

Walkersでもこれまで多数のAI活用プロジェクトを支援してきましたが、適切な設計・権限管理・ログ監視などの体制を整えることで、セキュリティ面で大きな問題なく運用できているケースがほとんどです。

AIを活用した開発に対して「危険なのではないか」という印象を持たれることがあります。しかしその多くは、AI技術そのものの問題ではなく、導入方法やガバナンス設計への理解不足から生まれています。

実際、AI駆動化に関する議論の中でも次のように指摘されています。

ここで重要なのは、AI駆動化とはエンジニアのスキルを拡張するための枠組みであって、最終責任をAIに委任するものではないという点です。意思決定の質と説明責任は常に人間側に残ります。

引用:https://japan.zdnet.com/article/35243445/ よりダウンロードできるPDF文書8ページ(ZDNET)

この指摘が示している通り、バイブコーディングとは「AIに任せきる開発」ではありません。

あくまで人間の判断力や設計力を拡張するための仕組みです。

世界的に利用されているAIプラットフォームやクラウド基盤は、厳格なセキュリティ基準やコンプライアンス体制のもとで運用されています。アクセス制御、暗号化、監査ログ、データ分離などの仕組みが標準で備わっているケースも多く、適切に設計すれば高い安全性を確保できます。

そのため、一般的なエンジニアがゼロからすべてを独自実装する場合と比較して、信頼性の高い基盤やツールを活用した方が、結果としてセキュリティレベルが高くなるケースも少なくありません。

重要なのは、「AIを使うかどうか」ではなく、どのような設計思想と運用体制でAIを活用するかです。

バイブコーディングのセキュリティは、AIそのものではなく、人間側の設計・統制・責任の持ち方によって決まります。

AI駆動開発プラットフォーム「Dify」のセキュリティ例

ここで、AI駆動開発において代表的なプラットフォームであるDifyのセキュリティ例について見ていきましょう。

Difyでは、AI開発におけるセキュリティやデータ保護の重要性を踏まえ、公式ドキュメントにてセキュリティ方針を公開しています。

Difyで行われている主なセキュリティ対策をおおまかに整理すると、以下の通りです。

- 米国の法律およびデータポリシーに準拠して運営されている

- クラウドサービスは米国Azure上で運用されている

- 承認された限られた担当者のみがユーザーデータへアクセス可能

- コードはGitHub上でオープンソースとして公開され透明性を確保

- セルフデプロイ(自社環境構築)に対応している

- SOC2およびISO27001認証の取得を予定している

また、Dify公式のデータセキュリティに関する説明では、次のように記載されています。

Dify 製品にご興味をお持ちいただきありがとうございます。Dify はお客様のデータ セキュリティを非常に重視しています。弊社の[プライバシー ポリシー]を参照してください。

Dify のクラウド サービスは米国 Azure 上にあり、承認を受けたごく少数の権限のある担当者のみがユーザー データにアクセスできるということです。また、弊社のコードは GitHub でオープンソース化されています。クラウド サービスのセキュリティに不安がある場合は、セルフデプロイ版をご利用いただくこともできます。

これらのセキュリティ対策が公開されていることから、Difyがデータ保護と透明性を重視して開発・運営されていることが分かります。

さらに、Dify公式は以下のようにも説明しています。

Dify は、米国の法律とデータ ポリシーを遵守し、世界的に多様なチームを擁する LangGenius, Inc. によって開発および運営されています。

ここから、AI駆動開発プラットフォームを提供する企業がセキュリティ対策に強く注力していることが読み取れます。

ここまでセキュリティ方針が明確に公開されていることが分かれば、Difyを利用する側としても安心して活用しやすいと言えるでしょう。

本記事ではDifyを具体例として紹介しましたが、主要なAI開発プラットフォームはセキュリティを重視して設計されているため、大半のツールは適切な運用を行えば安全に利用できると考えて問題ありません。

»関連記事:Difyは安全に使用できるのか?中国企業が運営しているって本当?セキュリティについて徹底解説!

バイブコーディング(AI駆動開発)のセキュリティが危険と言われる2つの理由

近年、バイブコーディングの普及に伴い「AIで開発するとセキュリティが危険なのでは?」という声を耳にする機会が増えました。

しかし実際には、バイブコーディングそのものが危険というわけではありません。

多くの場合、誤解や運用方法への理解不足が原因となっています。

バイブコーディングのセキュリティが不安視される主な理由は、以下の2つです。

- AIが勝手にシステムを作るため危険だという思い込み

- セキュリティはAIではなく利用者の運用に依存するため

それぞれ詳しく解説していきます。

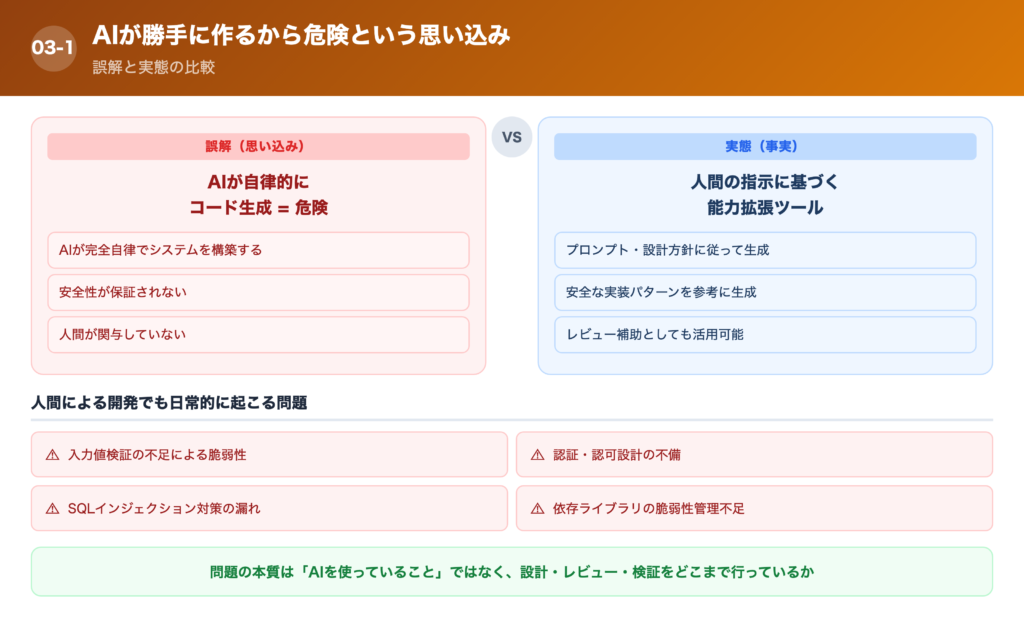

【理由①】AIが勝手に作るから危険という思い込み

バイブコーディングに対して最も多い誤解が、「AIが自動でコードを生成する=安全性が保証されない」という認識です。

確かにAIはコード生成や設計補助を行いますが、AIは完全自律でシステムを構築しているわけではありません。

実際には、人間が与えた指示(プロンプト)や設計方針に基づいて処理を生成しているに過ぎません。

つまり、AIは“開発者の能力を拡張するツール”であり、意思決定主体ではありません。

また、「人間がコードを書けば安全」という考え方も必ずしも正しくありません。

フルスクラッチ開発では以下のような問題が頻繁に発生します。

- 入力値検証の不足による脆弱性

- 認証・認可設計の不備

- SQLインジェクションやXSS対策の漏れ

- 依存ライブラリの脆弱性管理不足

これらはすべて人間による開発でも日常的に起こっている問題です。

むしろバイブコーディングでは、

- 既存の安全な実装パターンを参考に生成できる

- 最適解を提示できる

- レビュー補助として利用できる

といった理由から、適切に活用すればセキュリティ品質が向上するケースも少なくありません。

問題の本質は「AIを使っていること」ではなく、設計・レビュー・検証をどこまで行っているかにあります。

AIは危険なのではなく、使い方次第で安全性を高めることもできる技術です。

【理由②】セキュリティはAIではなく利用者に依存する

バイブコーディングに関するセキュリティ問題の多くは、AI自体ではなく利用者側の運用やリテラシーに起因しています。

実際に問題となるケースの多くは、以下のような人為的要因です。

- 機密情報をそのままAIへ入力してしまう

- アクセス権限管理を行っていない

- APIキーや認証情報を公開状態にしてしまう

- 開発ルールを定めないままAI導入を進める

これらはAI特有のリスクではなく、クラウドサービスやSaaS導入時にも同様に発生する典型的な運用問題です。

バイブコーディングの特徴として、「誰でも開発できる」ことがあります。

これは大きなメリットである一方、管理されていない開発環境が増えるリスクも生みます。

いわゆる「シャドーAI(管理外AI利用)」が発生しやすくなる点です。

例えば、

- 個人判断でAIツールを導入する

- 社内データを無断で外部AIへ投入する

- セキュリティポリシー未整備のまま運用開始する

といった状況では、どんな開発手法でもリスクは高まります。

つまり重要なのは、AIが安全かどうかではなく、AIを安全に運用できる体制があるかどうかです。

適切なガイドライン策定、アクセス制御、ログ管理、データ取り扱いルールを整備すれば、バイブコーディングは十分に安全に活用できます。

結論として、バイブコーディングのセキュリティはツールの問題ではなく、利用者の設計・運用・管理レベルに大きく依存すると言えるでしょう。

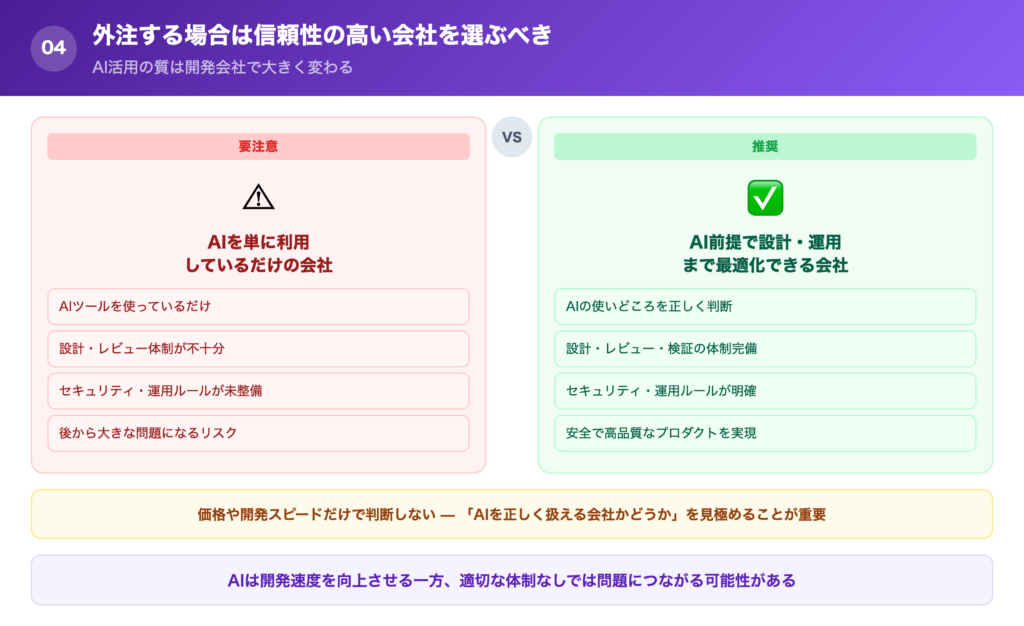

【重要】バイブコーディング(AI駆動開発)を外注する場合は信頼性の高い会社を選ぶべき

ここまで読み進めていただいた方の中には、バイブコーディングを外注し、新規サービスや業務システムを構築しようと考えている方も多いのではないでしょうか。

バイブコーディングを外注する際に最も重要なのは、信頼性の高い開発会社を選ぶことです。

バイブコーディングは近年急速に普及している新しい開発手法であり、「AIを使える」と掲げる会社は急増しています。しかし実際には、AIを単に利用しているだけの会社と、AIを前提に設計・運用まで最適化できる会社では、大きな差があります。

AIは開発速度を大きく向上させる一方で、設計・レビュー・セキュリティ・運用ルールが不十分なまま進めてしまうと、後から大きな問題につながる可能性もあります。

そのため、価格や開発スピードだけで判断するのではなく、「AIを正しく扱える会社かどうか」を見極めることが非常に重要になります。

バイブコーディング(AI駆動開発)会社の選ぶための5つのポイント

- 信頼できる実績があるか

- ブログやSNS、YouTubeで有益な発信がされているか

- 問い合わせた際の対応が丁寧か

- サポート体制は十分か

- 自社特有の課題を踏まえて提案してくれるか

【ポイント①】信頼できる実績があるか

バイブコーディング開発会社を選ぶ際は、必ず実績を確認することが重要です。

AIを活用した開発は、単にツールを使えば成立するものではなく、どの工程にAIを組み込み、どのように成果につなげているかによって品質やコストに大きな差が出ます。システム開発の依頼時には、AIの使いどころ・成果・失敗例まで踏み込んで確認することをおすすめします。

特に、自社が開発したいプロダクトと近い領域・フェーズでバイブコーディングの実績がある会社に依頼できると、要件定義や設計段階での認識ズレが起きにくく、プロジェクトをよりスムーズに進めやすくなります。

【ポイント②】ブログやSNS、YouTubeで有益な発信がされているか

バイブコーディング開発に関する情報発信が継続的に行われているかも、必ず確認しておきましょう。

生成AIやRAG、AIエージェントなどは変化が速く、実務で使える知見を持っているかどうかは発信内容に表れやすい分野です。あくまで肌感にはなりますが、ツール紹介にとどまらず、「どこでつまずきやすいか」「どう設計すべきか」「運用で何が問題になりやすいか」まで踏み込んだ有益な発信をしている会社に依頼した場合、プロジェクトが大きく破綻するケースは比較的少ないと感じています。

ブログやSNS、技術記事などをチェックしたうえで、

- この会社ならAIの使いどころをきちんと判断してくれそう

- 自社の課題やフェーズに合った提案をしてくれそう

と感じられる会社があれば、実際に問い合わせてみるのがおすすめです。

【ポイント③】問い合わせた際の対応が丁寧か

バイブコーディング開発でプロジェクトを円滑に進めるには、ヒアリングの質やレスポンスの丁寧さを重視して会社を選ぶことが重要です。

AIを活用した開発では、要件をそのまま実装するのではなく、どの工程にAIを組み込むか、どこは人が判断すべきかをすり合わせながら進めていく必要があります。そのため、開発は一方的な発注ではなく、綿密な対話を重ねる“二人三脚”の進め方になりやすく、コミュニケーションが噛み合わないと大きなストレスや手戻りにつながります。

まずは実際に問い合わせを行い、

- 課題を丁寧に言語化し直してくれるか

- AI活用の是非や代替案まで含めて説明してくれるか

- レスポンスが早く、論点が整理されているか

といった点を確認し、バイブコーディング開発を一緒に進められるパートナーかどうかを見極めることが大切です。

【ポイント④】サポート体制は十分か

バイブコーディング開発会社を選ぶ際は、サポート範囲まで含めて必ず確認しておくことが重要です。

生成AIや自動化を組み込んだシステムは、リリース後に精度調整・プロンプト改善・運用チューニングが必要になるケースも多く、想定外の挙動やトラブルが起こることを前提に考える必要があります。サポート内容が明確で充実している会社であれば、そうしたアクシデントが発生した際も、状況に応じて柔軟な対応を受けやすくなります。

バイブコーディング開発では「作って終わり」ではなく、運用しながら育てていくフェーズが重要です。

そのため、問い合わせ対応の範囲や改善対応、精度調整の相談可否などを事前に確認し、自社の事業フェーズに本当に必要なサポートが何かを見極めたうえで依頼先を選ぶと安心です。

【ポイント⑤】自社特有の課題を踏まえて提案してくれるか

バイブコーディング開発でサービス開発を成功させるには、自社特有の事業課題や状況を踏まえた提案をしてくれる会社を選ぶことが不可欠です。

AIを使った開発はスピードが出やすい反面、「作れるから作る」という判断に寄りやすく、目的やユーザーニーズが整理されていないまま進むと、完成しても使われないプロダクトになってしまうリスクがあります。そのため、単に言われたものを実装するだけでなく、どこにAIを使うべきか/使わない方がよいかまで踏み込んで提案してくれるかが重要です。

開発そのものに加えて、サービスの根幹となるアイデアの壁打ちや仮説検証、PoC段階での方向性整理まで伴走してくれる会社を選べると、バイブコーディング開発の強みを活かしながら、事業として成立するプロダクトを作りやすくなります。

【まとめ】バイブコーディング(AI駆動開発)のセキュリティについて

以下、バイブコーディングのセキュリティに関するポイントを簡単にまとめます。

- バイブコーディングそのものが危険というわけではなく、適切に設計すれば十分に安全に運用できる。

- 主要なAIツールやプラットフォームでは、高水準のセキュリティ対策やクラウド基盤が採用されている。

- 一方で、AIが生成したコードを理解せず利用すると、脆弱性が生まれる可能性がある。

- セキュリティの品質はツールではなく「設計・運用する人」に大きく依存する。

- バイブコーディングを外注する場合は、実績や運用ノウハウを持つ信頼性の高い会社を選ぶことが重要。

バイブコーディングのセキュリティについては様々な意見がありますが、正しく理解して活用すれば、過度に不安視する必要はありません。

ただし、AIが自動でコードを生成できるからといって、安全性まで自動で担保されるわけではありません。設計・権限管理・レビュー体制など、人による判断が依然として重要である点には注意が必要です。

Walkersでは成果が実証されたノウハウをもとに、事業を成功に導くためのAI開発×補助金支援を行っています。新規事業・システム開発でお悩みがある方はお気軽にご相談下さい。